J’espère que cette lecture vous aura mieux préparés aux risques potentiels liés à l’IA, qui rend l’économie de plus en plus imprévisible.

Et si notre optimisme concernant l’IA se confirmait… et si, en réalité, il était pessimiste ?

Citrini Research

Ce qui suit est un scénario, non une prédiction. Il ne s’agit ni de pornographie mettant en scène des ours, ni de fanfictions apocalyptiques sur l’IA. Le seul but de ce texte est de modéliser un scénario relativement peu exploré. Notre ami Alap Shah a posé la question, et nous avons réfléchi ensemble à la réponse. Nous avons rédigé cette partie, et il en a écrit deux autres que vous pouvez trouver ici .

J’espère que cette lecture vous aura mieux préparés aux risques potentiels liés à l’IA, qui rend l’économie de plus en plus imprévisible.

Voici la note macroéconomique de CitriniResearch de juin 2028, détaillant l’évolution et les conséquences de la crise mondiale du renseignement.

Mémo macro

Les conséquences de l’intelligence abondante

CitriniResearch

22 février 2026 – 30 juin 2028

Le taux de chômage s’est établi à 10,2 % ce matin, soit une surprise positive de 0,3 %. Le marché a reculé de 2 % suite à cette annonce, portant le repli cumulé du S&P 500 à 38 % par rapport à ses sommets d’octobre 2026.

Les investisseurs sont devenus insensibles. Il y a six mois, un tel résultat aurait déclenché un mécanisme de suspension des transactions.

Deux ans. C’est tout ce qu’il a fallu pour passer d’une économie « contenue » et « sectorielle » à une économie qui ne ressemble plus à celle que nous avons connue. La note macroéconomique de ce trimestre est notre tentative de reconstituer cette évolution – une analyse rétrospective de l’économie d’avant la crise.

L’euphorie était palpable. En octobre 2026, le S&P 500 frôlait les 8 000 points, le Nasdaq franchissait la barre des 30 000. La première vague de licenciements, due à l’obsolescence des compétences humaines, débuta début 2026 et produisit l’effet escompté : les marges progressèrent, les bénéfices dépassèrent les prévisions et les actions s’envolèrent. Les profits records des entreprises furent immédiatement réinvestis dans le calcul de l’IA.

Les chiffres officiels restaient excellents.

Le PIB nominal affichait régulièrement une croissance annuelle à un chiffre, de l’ordre de 5 à 9 %. La productivité était en plein essor. La production réelle par heure augmentait à des rythmes inédits depuis les années 1950, grâce à des agents d’intelligence artificielle qui ne dorment pas, ne prennent pas de congés maladie et n’ont pas besoin d’assurance maladie.

Les propriétaires d’ordinateurs ont vu leur richesse exploser avec la disparition des coûts de main-d’œuvre.

Parallèlement, la croissance des salaires réels s’est effondrée. Malgré les vantardises répétées du gouvernement concernant une productivité record, les cols blancs ont perdu leur emploi au profit des machines et ont été contraints d’accepter des postes moins bien rémunérés.

Lorsque des fissures ont commencé à apparaître dans l’économie de consommation, les experts économiques ont popularisé l’expression « PIB fantôme » : une production qui figure dans les comptes nationaux mais qui ne circule jamais dans l’économie réelle.

L’IA dépassait toutes les attentes, et le marché était dominé par l’IA. Le seul problème… l’économie, elle, ne suivait pas.

Il aurait dû être évident dès le départ qu’un simple cluster de GPU dans le Dakota du Nord, produisant la même quantité de ressources que celle auparavant attribuée à 10 000 employés de bureau à Manhattan, s’apparente davantage à une pandémie économique qu’à une solution miracle.

La vitesse de circulation de la monnaie s’est effondrée. L’économie de consommation, centrée sur l’humain et représentant alors 70 % du PIB, s’est effondrée. Nous aurions probablement pu le comprendre plus tôt en nous demandant simplement combien d’argent les machines dépensent en biens non essentiels. (réponse : zéro.)

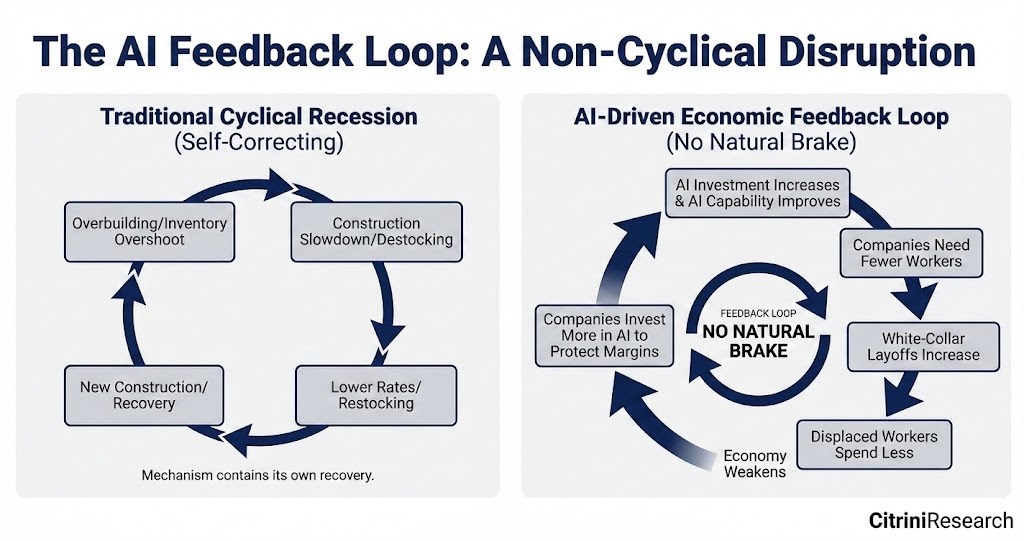

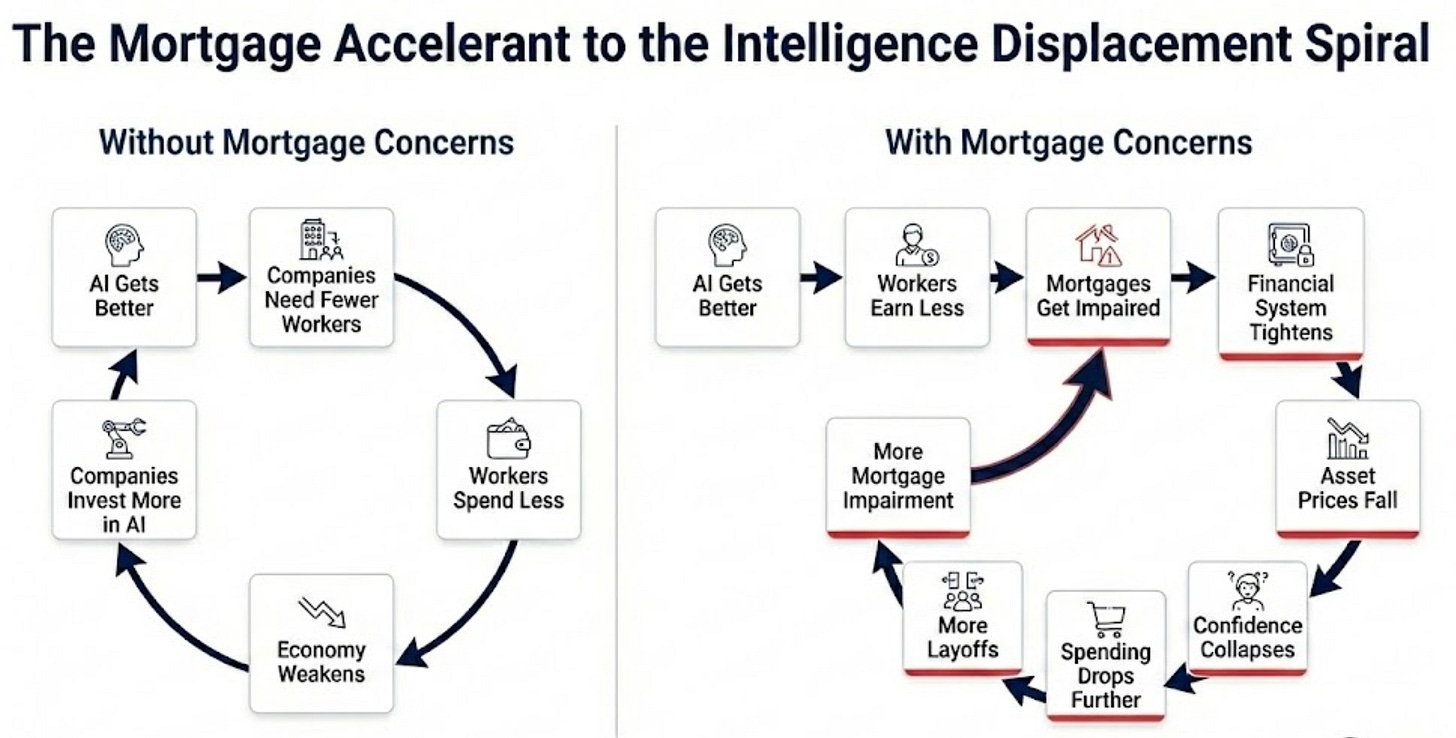

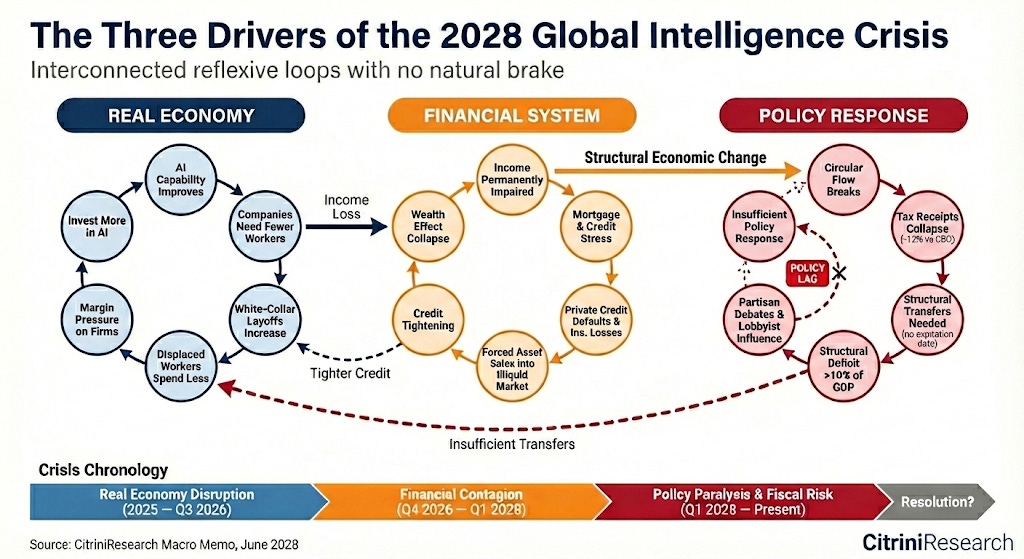

Les capacités de l’IA se sont améliorées, les entreprises ont eu besoin de moins de personnel, les licenciements de cols blancs ont augmenté, les travailleurs licenciés ont dépensé moins, la pression sur les marges a poussé les entreprises à investir davantage dans l’IA, les capacités de l’IA se sont améliorées…

C’était un cercle vicieux sans frein naturel : la spirale du déplacement de l’intelligence humaine . Les cols blancs ont vu leur pouvoir d’achat (et, logiquement, leurs dépenses) structurellement affecté. Leurs revenus constituaient le socle du marché hypothécaire de 13 000 milliards de dollars, obligeant les assureurs à se demander si les prêts hypothécaires de premier ordre étaient toujours rentables.

Dix-sept années sans véritable cycle de défauts de paiement avaient laissé le secteur privé saturé d’opérations logicielles soutenues par du capital-investissement, qui supposaient que les revenus annuels récurrents resteraient stables. La première vague de défauts de paiement, due à la disruption causée par l’IA au milieu de l’année 2027, a remis en question cette hypothèse.

La situation aurait été gérable si la perturbation s’était limitée aux logiciels, mais ce ne fut pas le cas. Fin 2027, elle menaçait tous les modèles économiques fondés sur l’intermédiation. Des pans entiers d’entreprises bâties sur la monétisation des difficultés rencontrées par les individus se sont effondrés.

Le système s’est révélé être une longue chaîne de paris interdépendants sur la croissance de la productivité des cols blancs. Le krach de novembre 2027 n’a fait qu’accélérer tous les cercles vicieux déjà en place.

Cela fait près d’un an que nous attendons que les mauvaises nouvelles se transforment en bonnes nouvelles. Le gouvernement commence à examiner des propositions, mais la confiance du public dans sa capacité à mettre en œuvre un quelconque plan de sauvetage s’est considérablement érodée. Les mesures politiques ont toujours été en décalage avec la réalité économique, mais l’absence d’un plan global menace désormais d’accélérer une spirale déflationniste.

Comment tout a commencé

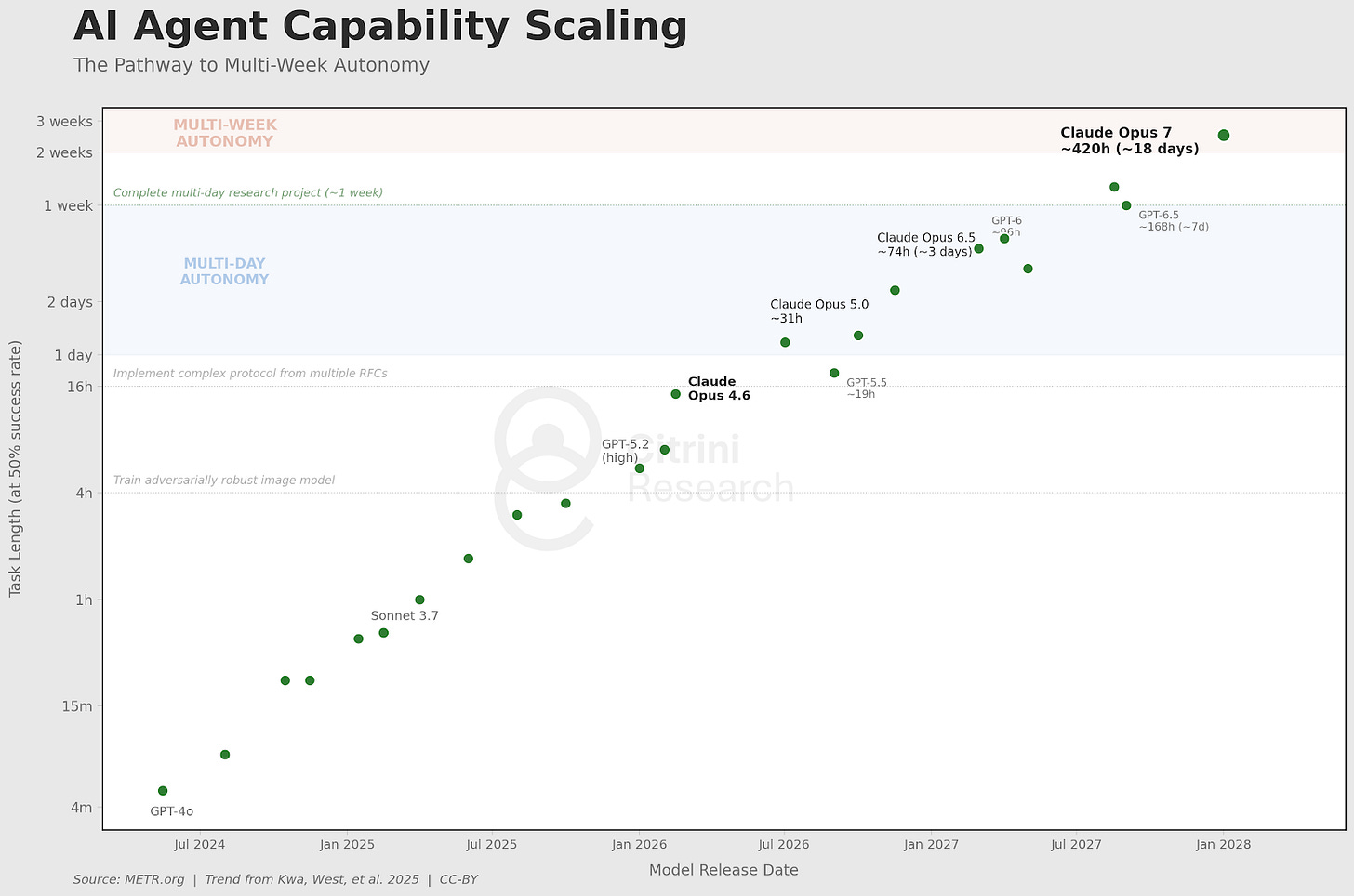

Fin 2025, les outils de codage agentique ont fait un bond en avant considérable en termes de capacités.

Un développeur compétent utilisant Claude Code ou Codex peut désormais reproduire en quelques semaines les fonctionnalités essentielles d’un produit SaaS de taille moyenne. Certes, pas parfaitement, ni en couvrant tous les cas particuliers, mais suffisamment bien pour que le DSI, examinant un renouvellement annuel de 500 000 $, se demande : « Et si on le développait nous-mêmes ? »

Les exercices fiscaux coïncident généralement avec les années civiles ; ainsi, les dépenses des entreprises pour 2026 avaient été fixées au quatrième trimestre 2025, alors que l’« IA agentielle » n’était encore qu’un concept à la mode. L’examen de mi-année a été la première occasion pour les équipes d’approvisionnement de prendre des décisions en ayant une vision claire des capacités réelles de ces systèmes. Certaines ont vu leurs équipes internes développer en quelques semaines des prototypes reproduisant des contrats SaaS à six chiffres.

Cet été-là, nous avons discuté avec un responsable des achats d’une entreprise du Fortune 500. Il nous a raconté l’une de ses négociations budgétaires. Le commercial s’attendait à réitérer l’opération de l’année précédente : une augmentation de prix annuelle de 5 % et le traditionnel argumentaire du type « votre équipe compte sur nous ». Le responsable des achats lui a alors expliqué qu’il avait entamé des discussions avec OpenAI afin que leurs ingénieurs déployés sur le terrain utilisent des outils d’IA pour remplacer complètement le fournisseur. Ils ont finalement renouvelé leur contrat avec une réduction de 30 %. Un bon résultat, selon lui. Les entreprises SaaS de niche, comme Monday.com , Zapier et Asana, ont connu des difficultés bien plus importantes.

Les investisseurs étaient préparés, voire s’attendaient à ce que le segment des solutions à long terme soit fortement impacté. Bien qu’il ne représente qu’un tiers des dépenses liées à l’infrastructure informatique d’une entreprise type, son exposition était indéniable. Les systèmes d’information de référence, en revanche, étaient censés être à l’abri des perturbations.

Ce n’est qu’avec le rapport du troisième trimestre 2026 de ServiceNow que le mécanisme de réflexivité est devenu plus clair.

La croissance nette des nouveaux contrats de ServiceNow ralentit à 14 % contre 23 % précédemment ; l’entreprise annonce une réduction de 15 % de ses effectifs et un programme d’amélioration de son efficacité structurelle ; le cours de l’action chute de 18 % | Bloomberg, octobre 2026

Le SaaS n’était pas « mort ». L’analyse coûts-avantages du développement et de la maintenance en interne restait pertinente. Mais cette option demeurait envisageable et était prise en compte dans les négociations tarifaires.

Plus important encore, le paysage concurrentiel avait évolué. L’IA avait simplifié le développement et le déploiement de nouvelles fonctionnalités, rendant la différenciation obsolète. Les acteurs historiques se livraient à une guerre des prix acharnée, une lutte sans merci entre eux et avec la nouvelle génération de challengers émergents. Forts des progrès fulgurants en matière de programmation automatisée et sans structure de coûts héritée à protéger, ces derniers ont conquis des parts de marché de manière agressive.

L’interconnexion de ces systèmes n’a été pleinement comprise qu’avec cette publication. ServiceNow vendait des licences. Lorsque les clients du Fortune 500 réduisaient leurs effectifs de 15 %, ils annulaient également 15 % de leurs licences. Ces mêmes réductions d’effectifs, impulsées par l’IA et qui dopaient les marges de leurs clients, détruisaient mécaniquement leur propre chiffre d’affaires.

L’entreprise qui vendait des solutions d’automatisation des flux de travail était perturbée par une automatisation des flux de travail plus performante, et sa réponse a été de réduire ses effectifs et d’utiliser les économies réalisées pour financer la technologie même qui la perturbait.

Que pouvaient-ils faire d’autre ? Rester les bras croisés et mourir à petit feu ? Les entreprises les plus menacées par l’IA sont devenues les plus ferventes utilisatrices de cette technologie.

Cela paraît évident avec le recul, mais ça ne l’était pas du tout à l’époque (du moins pour moi). Le modèle historique de disruption prévoyait que les entreprises établies résistent aux nouvelles technologies, perdent des parts de marché au profit de nouveaux acteurs agiles et disparaissent lentement. C’est ce qui est arrivé à Kodak, à Blockbuster et à BlackBerry. Ce qui s’est passé en 2026 était différent : les entreprises établies n’ont pas résisté, car elles n’en avaient pas les moyens.

Face à des actions en chute libre de 40 à 60 % et à des conseils d’administration exigeant des explications, les entreprises menacées par l’IA n’avaient d’autre choix que de réduire leurs effectifs, de réinvestir les économies réalisées dans des outils d’IA et d’utiliser ces outils pour maintenir leur production à moindre coût.

Chaque entreprise a réagi de manière rationnelle. Le résultat collectif a été catastrophique. Chaque dollar économisé sur les effectifs a été investi dans le développement de l’IA, rendant possible la vague suivante de suppressions d’emplois.

Le logiciel n’était que le prélude. Ce que les investisseurs ont omis de mentionner, pendant leurs débats sur le point de basculer dans le secteur SaaS, c’est que ce cercle vicieux s’était déjà propagé. La même logique qui justifiait les réductions d’effectifs chez ServiceNow s’appliquait désormais à toutes les entreprises dont la structure de coûts repose sur des employés de bureau.

Lorsque le frottement est devenu nul

Début 2027, l’utilisation de LLM était devenue la norme. On utilisait des agents d’IA sans même savoir ce qu’était un agent d’IA, de la même manière que ceux qui ignoraient tout du « cloud computing » utilisaient les services de streaming. Ils le percevaient comme la saisie semi-automatique ou le correcteur orthographique : une fonctionnalité désormais naturelle sur leur téléphone.

L’assistant d’achat open source de Qwen a été le catalyseur de l’essor de l’IA dans la gestion des décisions de consommation. En quelques semaines, tous les principaux assistants vocaux ont intégré une fonctionnalité de commerce automatisé. Grâce à des modèles simplifiés, ces agents peuvent fonctionner sur téléphones et ordinateurs portables, et non plus seulement dans le cloud, réduisant ainsi considérablement le coût marginal de l’inférence.

Ce qui aurait dû inquiéter davantage les investisseurs, c’est que ces agents n’attendaient pas d’être sollicités. Ils fonctionnaient en arrière-plan, selon les préférences de l’utilisateur. Le commerce, autrefois une succession de décisions humaines ponctuelles, est devenu un processus d’optimisation continu, fonctionnant 24 h/24 et 7 j/7 pour chaque consommateur connecté. En mars 2027, l’Américain moyen consommait 400 000 jetons par jour, soit dix fois plus qu’à fin 2026.

Le maillon suivant de la chaîne était déjà en train de se rompre.

Intermédiation.

Au cours des cinquante dernières années, l’économie américaine a bâti un système de rente colossal qui s’est greffé aux limites humaines : le temps est une denrée rare, la patience a ses limites, la notoriété de la marque remplace la rigueur, et la plupart des gens préfèrent accepter un prix élevé plutôt que de cliquer inutilement. Des milliers de milliards de dollars de valeur d’entreprise reposaient sur la persistance de ces contraintes.

Au départ, c’était assez simple. Les agents ont éliminé les obstacles.

Des abonnements et des adhésions qui se renouvelaient automatiquement malgré des mois d’inutilisation. Des prix de lancement qui doublaient sournoisement après la période d’essai. Chaque formule était présentée comme une prise d’otage que les agents pouvaient négocier. La valeur vie client moyenne, indicateur clé sur lequel reposait toute l’économie de l’abonnement, a chuté de façon significative.

Les agents de consommateurs ont commencé à modifier le fonctionnement de la quasi-totalité des transactions de consommation.

Les humains n’ont pas vraiment le temps de comparer les prix sur cinq plateformes concurrentes avant d’acheter une boîte de barres protéinées. Les machines, si.

Les plateformes de réservation de voyages ont été parmi les premières victimes, car elles étaient les plus simples. D’ici le quatrième trimestre 2026, nos agents pourront élaborer un itinéraire complet (vols, hôtels, transferts, optimisation des programmes de fidélité, gestion du budget, remboursements) plus rapidement et à moindre coût que n’importe quelle plateforme.

Le renouvellement des contrats d’assurance, dont le modèle reposait entièrement sur l’inertie des assurés, a été réformé. Les agents qui comparent les offres chaque année ont supprimé les 15 à 20 % de primes que les assureurs percevaient grâce aux renouvellements passifs.

Conseils financiers. Préparation des déclarations fiscales. Travaux juridiques courants. Toute catégorie où la proposition de valeur du prestataire de services se résumait à « Je vais vous simplifier la complexité qui vous paraît fastidieuse » a été bouleversée, car les agents n’ont rien trouvé de fastidieux.

Même les secteurs que l’on croyait protégés par l’importance des relations humaines se sont révélés fragiles. L’immobilier, où les acheteurs avaient toléré des commissions de 5 à 6 % pendant des décennies en raison de l’asymétrie d’information entre agent et client, s’est effondré lorsque des agents IA, dotés d’un accès au MLS et de décennies de données transactionnelles, ont pu reproduire instantanément cette base de connaissances. Un article du côté vendeur, paru en mars 2027, évoquait la « violence entre agents ». La commission médiane à l’achat dans les grandes métropoles est passée de 2,5-3 % à moins de 1 %, et une part croissante des transactions se concluait sans aucun agent humain du côté acheteur.

Nous avions surestimé la valeur des « relations humaines ». Il s’avère que beaucoup de ce que les gens appelaient relations n’était en réalité que des frictions déguisées en relations amicales.

Ce n’était que le début de la transformation du secteur de l’intermédiation. Les entreprises prospères avaient dépensé des milliards pour exploiter efficacement des particularités du comportement des consommateurs et de la psychologie humaine qui n’avaient plus aucune importance.

Les algorithmes qui optimisent les prix et la compatibilité ne tiennent aucun compte de votre application préférée ni des sites web que vous consultez régulièrement depuis quatre ans, et ne sont pas sensibles à l’attrait d’une expérience de paiement bien conçue. Ils ne se lassent pas et n’acceptent pas l’option la plus facile ni le réflexe de « je commande toujours ici ».

Cela a détruit un type particulier de rempart : l’intermédiation habituelle.

DoorDash (DASH US) en était l’exemple type.

Les agences de développement ont fait tomber les barrières à l’entrée pour le lancement d’une application de livraison. Un développeur compétent pouvait déployer une application concurrente fonctionnelle en quelques semaines, et des dizaines l’ont fait, attirant les livreurs de DoorDash et Uber Eats en leur reversant 90 à 95 % des frais de livraison. Les tableaux de bord multi-applications permettaient aux travailleurs indépendants de suivre simultanément les courses provenant de vingt ou trente plateformes, supprimant ainsi la dépendance vis-à-vis des acteurs historiques. Le marché s’est fragmenté du jour au lendemain et les marges se sont effondrées.

Les agents ont accéléré la destruction des deux côtés. Ils ont permis aux concurrents de prospérer, puis ils les ont exploités. L’avantage concurrentiel de DoorDash résidait littéralement dans le fait qu’« envie de manger ou de se détendre ? C’est l’appli qu’il vous faut sur votre écran d’accueil ». Un agent, lui, n’a pas d’écran d’accueil. Il compare DoorDash, Uber Eats, le site du restaurant et une vingtaine d’autres alternatives, chacune avec son propre style, afin de choisir systématiquement l’option la plus économique et la livraison la plus rapide.

La fidélité habituelle aux applications, fondement même du modèle économique, n’existait tout simplement pas pour une machine.

Ironie du sort, c’était peut-être le seul exemple, dans toute cette histoire, où des agents rendaient service aux cols blancs sur le point d’être remplacés. Lorsqu’ils sont devenus livreurs, au moins la moitié de leurs revenus n’allait pas à Uber et DoorDash. Bien sûr, ce service rendu par la technologie n’a pas duré longtemps avec la prolifération des véhicules autonomes.

Une fois la transaction maîtrisée, les agents se mirent en quête de trombones plus gros.

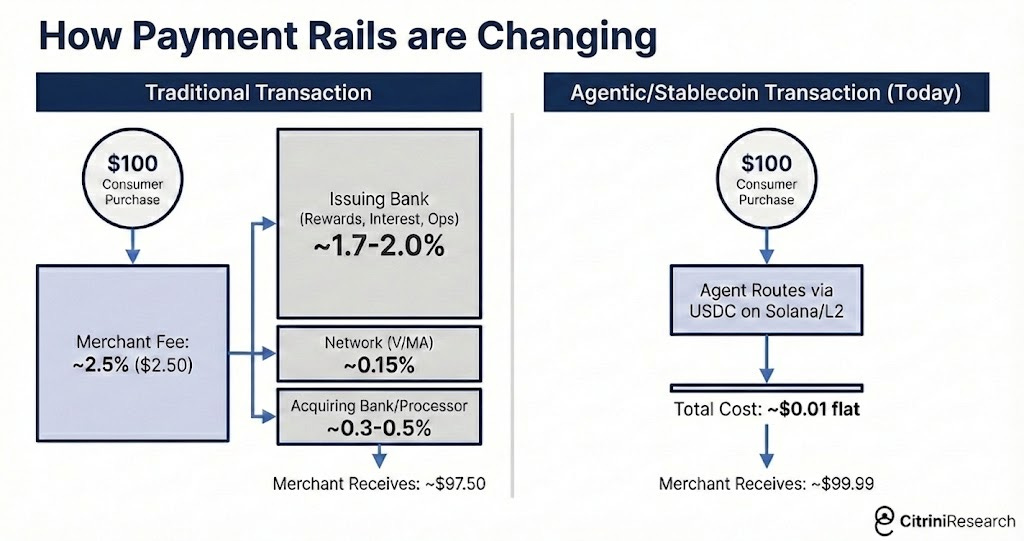

Les possibilités de comparaison et de regroupement des prix étaient limitées. Le meilleur moyen de faire économiser de l’argent à l’utilisateur de façon régulière (surtout lorsque les agents ont commencé à effectuer des transactions entre eux) était de supprimer les frais. Dans le commerce de machine à machine, le taux d’interchange de 2 à 3 % par carte est devenu une cible évidente.

Les agents se sont mis en quête d’options plus rapides et moins coûteuses que les cartes. La plupart ont opté pour l’utilisation de stablecoins via Solana ou Ethereum L2, où le règlement était quasi instantané et le coût de transaction se mesurait en fractions de centime.

MASTERCARD T1 2027 : CHIFFRE D’AFFAIRES NET EN HAUSSE DE 6 % SUR UN AN ; LA CROISSANCE DU VOLUME D’ACHAT RALENTIT À +3,4 % SUR UN AN, CONTRE +5,9 % AU TRIMESTRE PRÉCÉDENT ; LA DIRECTION INDIQUE UNE « OPTIMISATION DES PRIX PAR LES AGENTS » ET UNE « PRESSION SUR LES CATÉGORIES DISCRÉTIONNAIRES » | Bloomberg, 29 avril 2027

Le rapport du premier trimestre 2027 de Mastercard a marqué un tournant décisif. Le commerce mobile, autrefois considéré comme un produit, est devenu un véritable casse-tête. Le cours de MA a chuté de 9 % le lendemain. Visa a également connu une baisse, avant de limiter ses pertes après que les analystes ont souligné son positionnement plus solide dans l’infrastructure des stablecoins.

Le routage des transactions commerciales par agents, contournant les commissions d’interchange, représentait un risque bien plus important pour les banques axées sur les cartes et les émetteurs mono-marque, qui percevaient la majeure partie de ces frais de 2 à 3 % et avaient bâti des segments d’activité entiers autour de programmes de récompenses financés par la subvention aux commerçants.

American Express (AXP US) a été la plus durement touchée, subissant de plein fouet les conséquences de réductions d’effectifs dans les bureaux de paie, qui ont considérablement réduit sa clientèle, et de la perturbation des circuits de correspondance de ses agents, qui a fortement impacté son modèle de revenus. Synchrony (SYF US), Capital One (COF US) et Discover (DFS US) ont également enregistré des baisses de plus de 10 % au cours des semaines suivantes.

Leurs douves étaient constituées de friction. Et la friction tendait vers zéro.

Du risque sectoriel au risque systémique

Jusqu’en 2026, les marchés ont considéré l’impact négatif de l’IA comme un phénomène sectoriel. Les logiciels et le conseil ont subi de fortes pressions, les paiements et autres services publics ont connu des difficultés, mais l’économie dans son ensemble semblait se porter bien. Le marché du travail, bien que légèrement ralenti, n’était pas en chute libre. L’opinion générale était que la destruction créatrice faisait partie intégrante de tout cycle d’innovation technologique. Elle serait douloureuse dans certains secteurs, mais les avantages nets de l’IA l’emporteraient globalement sur les inconvénients.

Notre note macroéconomique de janvier 2027 affirmait que ce modèle mental était erroné. L’économie américaine repose sur les services et les employés de bureau. Ces derniers représentaient 50 % de l’emploi et généraient environ 75 % des dépenses de consommation discrétionnaires. Les entreprises et les emplois que l’IA détruisait n’étaient pas périphériques à l’économie américaine ; ils en étaient le cœur même.

« L’innovation technologique détruit des emplois, puis en crée encore davantage. » C’était l’argument le plus répandu et le plus convaincant à l’époque. Il était populaire et convaincant car il s’était avéré juste pendant deux siècles. Même si nous ne pouvions imaginer quels seraient les emplois de demain, ils finiraient par apparaître.

Les guichets automatiques ont permis de réduire les coûts d’exploitation des agences bancaires, ce qui a incité les banques à en ouvrir davantage et a entraîné une hausse du nombre de guichetiers pendant les vingt années suivantes. Internet a bouleversé les agences de voyages, les Pages Jaunes et le commerce de détail traditionnel, mais il a aussi donné naissance à des secteurs d’activité entièrement nouveaux, créateurs d’emplois inédits.

Chaque nouvel emploi, cependant, nécessitait un être humain pour l’accomplir.

L’IA est désormais une intelligence générale qui excelle dans les tâches mêmes auxquelles les humains seraient redéployés. Les développeurs licenciés ne peuvent pas se reconvertir dans la « gestion de l’IA », car celle-ci en est déjà capable.

Aujourd’hui, les agents d’IA prennent en charge des tâches de recherche et développement qui durent plusieurs semaines. La croissance exponentielle a bouleversé notre conception du possible, malgré les efforts annuels des professeurs de Wharton pour modéliser les données à l’aide d’une nouvelle fonction sigmoïde.

Ils écrivent la quasi-totalité du code. Les plus performants d’entre eux sont nettement plus intelligents que la quasi-totalité des humains dans presque tous les domaines. Et leurs services ne cessent de devenir moins chers.

L’IA a créé de nouveaux emplois : ingénieurs en informatisation, chercheurs en sécurité de l’IA, techniciens d’infrastructure. L’humain reste impliqué, assurant la coordination au plus haut niveau ou apportant son expertise. Cependant, pour chaque nouveau poste créé par l’IA, des dizaines d’autres sont devenus obsolètes. De plus, les nouveaux emplois sont bien moins rémunérateurs que les anciens.

SECOURS AUX ÉTATS-UNIS : LES OFFRES D’EMPLOI CHUTENT SOUS LA LIMITE DE 5,5 MILLIONS ; LE RAPPORT CHÔMAGE/OFFRES D’EMPLOI ACCRUT À ENVIRON 1,7, SON PLUS HAUT NIVEAU DEPUIS AOÛT 2020 | Bloomberg, octobre 2026

Le rythme des embauches était resté faible tout au long de l’année, mais l’édition d’octobre 2026 de JOLTS a fourni des données définitives. Le nombre d’offres d’emploi est tombé sous la barre des 5,5 millions, soit une baisse de 15 % par rapport à l’année précédente.

EN EFFET : LES OFFRES D’EMPLOI CHUTE FORTE DANS LES SECTEURS DU LOGICIEL, DE LA FINANCE ET DU CONSEIL À FOND SUR LES « INITIATIVES DE PRODUCTIVITÉ » | Indeed Hiring Lab, nov.-déc. 2026

Les offres d’emploi pour les cols blancs s’effondraient tandis que celles pour les cols bleus restaient relativement stables (construction, santé, métiers manuels). Le plus fort taux de renouvellement concernait les emplois administratifs (nous sommes, on ne sait comment, toujours en activité) , l’approbation des budgets et les services intermédiaires de l’économie. La croissance des salaires réels dans les deux catégories était cependant négative depuis le début de l’année et a continué de baisser.

Le marché boursier se souciait encore moins de JOLTS que de l’annonce que toute la capacité de production de turbines de GE Vernova était désormais vendue jusqu’en 2040 ; il a stagné, tiraillé entre les mauvaises nouvelles macroéconomiques et les annonces positives concernant les infrastructures d’IA.

Le marché obligataire (toujours plus avisé que le marché actions, ou du moins moins romantique) a commencé à intégrer le choc sur la consommation. Le rendement à 10 ans a ainsi amorcé une baisse, passant de 4,3 % à 3,2 % au cours des quatre mois suivants. Malgré cela, le taux de chômage officiel n’a pas explosé, et certains ont encore perdu de vue les subtilités de sa composition.

Lors d’une récession classique, la cause finit par se corriger d’elle-même. La surproduction entraîne un ralentissement du secteur de la construction, ce qui provoque une baisse des prix et, par conséquent, une reprise de la construction. Le surplus de stocks conduit à un déstockage, qui entraîne un réapprovisionnement. Ce mécanisme cyclique porte en lui les germes de la reprise.

La cause de ce cycle n’était pas cyclique.

L’IA est devenue plus performante et moins chère. Les entreprises ont licencié du personnel, puis ont utilisé les économies réalisées pour acquérir davantage de capacités en IA, ce qui leur a permis de licencier encore plus de personnel. Les employés licenciés ont dépensé moins. Les entreprises qui vendent des biens de consommation ont vendu moins, se sont affaiblies et ont investi davantage dans l’IA pour préserver leurs marges. L’IA est devenue plus performante et moins chère.

Une boucle de rétroaction sans frein naturel.

On s’attendait intuitivement à ce que la baisse de la demande globale ralentisse le déploiement de l’IA. Or, ce ne fut pas le cas, car il ne s’agissait pas d’investissements d’investissement (CapEx) comme chez les hyperscalers, mais d’une substitution des dépenses d’exploitation (OpEx). Une entreprise qui dépensait 100 millions de dollars par an pour ses employés et 5 millions pour l’IA consacrait désormais 70 millions de dollars à ses employés et 20 millions à l’IA. Les investissements en IA ont été multipliés, mais cette augmentation s’est traduite par une réduction des coûts d’exploitation totaux. Le budget IA de chaque entreprise a augmenté tandis que ses dépenses globales diminuaient.

L’ironie de la situation résidait dans le fait que l’infrastructure d’IA continuait de prospérer malgré la détérioration de l’économie qu’elle bouleversait. NVDA affichait toujours des revenus records. TSM fonctionnait toujours à plus de 95 % de sa capacité. Les hyperscalers continuaient d’investir entre 150 et 200 milliards de dollars par trimestre dans les centres de données. Les économies qui suivaient de près cette tendance, comme Taïwan et la Corée du Sud, ont enregistré des performances nettement supérieures.

L’Inde présentait le cas inverse. Son secteur des services informatiques exportait plus de 200 milliards de dollars par an, contribuant largement à l’excédent de sa balance des paiements courants et compensant son déficit commercial persistant. Tout le modèle reposait sur un argument de vente unique : les développeurs indiens coûtaient une fraction du prix de leurs homologues américains. Or, le coût marginal d’un agent de codage IA s’était effondré, atteignant quasiment le prix de l’électricité. TCS, Infosys et Wipro ont vu les annulations de contrats s’accélérer tout au long de 2027. La roupie a chuté de 18 % face au dollar en quatre mois, l’excédent des services qui soutenait les comptes extérieurs de l’Inde s’étant évaporé. Au premier trimestre 2028, le FMI a entamé des « discussions préliminaires » avec New Delhi.

Le mécanisme à l’origine de ces perturbations s’améliorait chaque trimestre, ce qui avait pour conséquence d’accélérer les perturbations elles-mêmes. Le marché du travail ne connaissait aucune limite naturelle.

Aux États-Unis, on ne s’interrogeait plus sur l’éclatement de la bulle dans le domaine des infrastructures d’IA. On se demandait plutôt ce qu’il adviendrait d’une économie de crédit à la consommation lorsque les consommateurs seraient remplacés par des machines .

La spirale du déplacement des renseignements

C’est en 2027 que la situation macroéconomique a cessé d’être subtile. Le mécanisme de transmission des douze mois précédents, marqués par une évolution certes décousue mais clairement négative, est devenu évident. Inutile de consulter les données du BLS : un simple dîner entre amis suffisait.

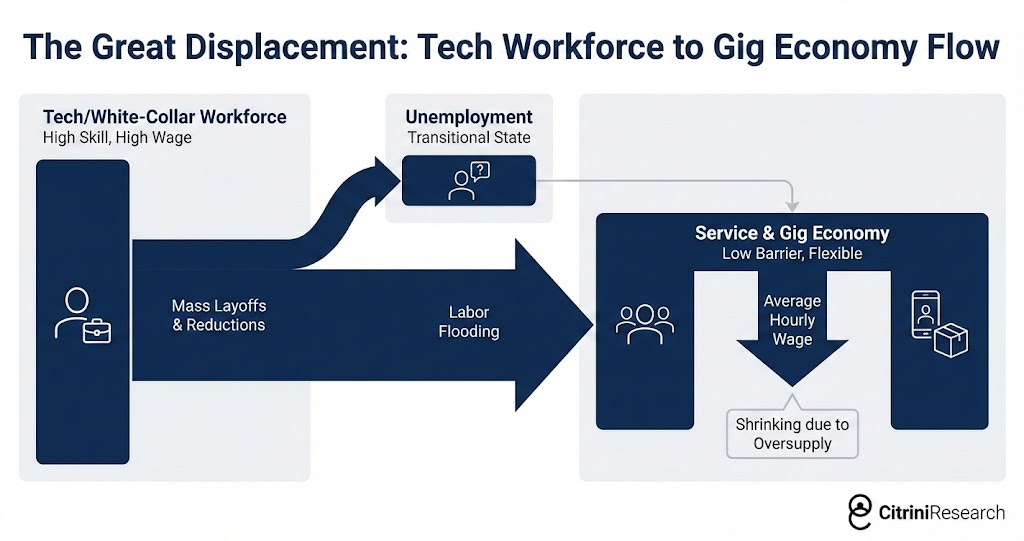

Les cols blancs licenciés ne sont pas restés inactifs. Ils se sont reconvertis. Nombre d’entre eux ont accepté des emplois moins bien rémunérés dans le secteur des services et l’économie collaborative, ce qui a accru l’offre de main-d’œuvre dans ces segments et a également comprimé les salaires.

Une amie était chef de produit senior chez Salesforce en 2025. Poste permanent, assurance maladie, plan d’épargne retraite, 180 000 $ par an. Elle a perdu son emploi lors de la troisième vague de licenciements. Après six mois de recherche, elle s’est mise à conduire pour Uber. Ses revenus ont chuté à 45 000 $. L’important n’est pas tant l’histoire individuelle que les conséquences à long terme. Multipliez cette dynamique par quelques centaines de milliers de travailleurs dans toutes les grandes métropoles. L’afflux de main-d’œuvre surqualifiée dans l’économie des services et des plateformes a tiré les salaires vers le bas pour les travailleurs déjà en difficulté. Les perturbations sectorielles ont entraîné une compression salariale généralisée.

Le paysage encore centré sur l’humain allait connaître une nouvelle correction, qui se déroule sous nos yeux au moment même où nous écrivons ces lignes. Avec l’essor des livraisons autonomes et des véhicules sans conducteur au sein de l’économie collaborative qui a absorbé la première vague de travailleurs déplacés.

En février 2027, il était clair que les professionnels encore en poste dépensaient comme s’ils étaient les prochains sur la liste. Ils travaillaient deux fois plus (principalement grâce à l’IA) pour éviter le licenciement, et tout espoir de promotion ou d’augmentation s’était envolé. Le taux d’épargne augmentait légèrement, tandis que les dépenses diminuaient.

Le plus dangereux, c’était le décalage. Les plus hauts revenus ont utilisé leur épargne, supérieure à la moyenne, pour maintenir une apparence de normalité pendant deux ou trois trimestres. Les données concrètes n’ont confirmé le problème que lorsqu’il était déjà bien ancré dans l’économie réelle. Puis est apparue la publication qui a brisé l’illusion.

Aux États-Unis, les demandes initiales d’allocations chômage atteignent 487 000, un niveau jamais vu depuis avril 2020 ; Département du Travail, 3e trimestre 2027

Les demandes initiales ont bondi à 487 000, un niveau jamais atteint depuis avril 2020. ADP et Equifax ont confirmé que l’immense majorité des nouvelles demandes provenaient de professionnels en col blanc.

L’indice S&P a chuté de 6 % la semaine suivante. Les facteurs macroéconomiques négatifs ont commencé à prendre le dessus.

En période de récession classique, les pertes d’emplois sont largement réparties. Les ouvriers et les employés sont touchés proportionnellement à leur part respective dans l’emploi. Le recul de la consommation est lui aussi largement réparti et se manifeste rapidement dans les données, car les travailleurs à faibles revenus ont une propension marginale à consommer plus élevée.

Dans ce cycle, les pertes d’emplois se sont concentrées sur les 10 % des revenus les plus élevés. Bien que représentant une part relativement faible de l’emploi total, ces revenus exercent une influence disproportionnée sur les dépenses de consommation. Les 10 % des ménages les plus aisés représentent plus de 50 % des dépenses de consommation aux États-Unis, et les 20 % les plus riches, environ 65 %. Ce sont eux qui achètent les maisons, les voitures, les vacances, les repas au restaurant, les frais de scolarité dans les écoles privées et les travaux de rénovation. Ils constituent le principal moteur de la demande pour l’ensemble du secteur de la consommation discrétionnaire.

Lorsque ces travailleurs ont perdu leur emploi ou ont accepté une réduction de salaire de 50 % pour occuper des postes disponibles, le manque à gagner pour la consommation a été considérable par rapport au nombre d’emplois perdus. Une baisse de 2 % de l’emploi des cols blancs s’est traduite par une diminution de 3 à 4 % des dépenses de consommation discrétionnaires. Contrairement aux pertes d’emploi des cols bleus, dont l’impact est généralement immédiat (un licenciement entraîne une réduction des dépenses la semaine suivante), les pertes d’emploi des cols blancs ont un impact différé mais plus profond, car ces travailleurs disposent d’une épargne qui leur permet de maintenir leurs dépenses pendant quelques mois avant que le changement de comportement ne se produise.

Au deuxième trimestre 2027, l’économie était en récession. Le NBER n’a pas officiellement daté le début de la récession avant plusieurs mois (comme toujours), mais les données étaient sans équivoque : nous avions enregistré deux trimestres consécutifs de croissance négative du PIB réel. Mais il ne s’agissait pas encore d’une « crise financière ».

La chaîne de paris corrélés

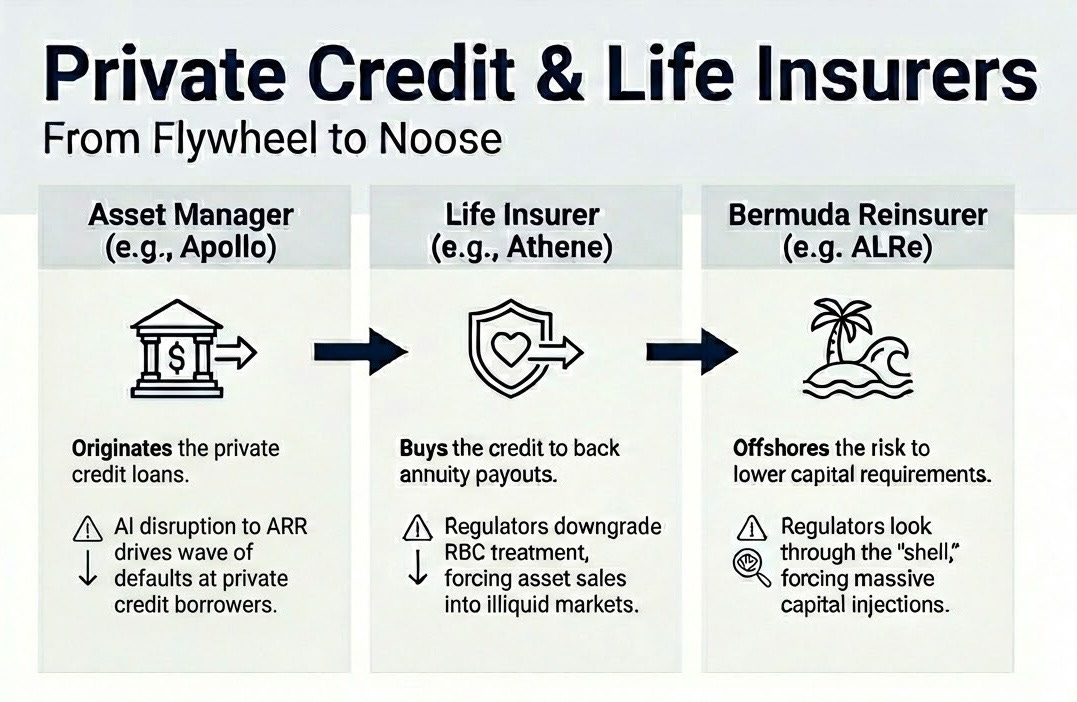

Le crédit privé est passé de moins de 1 000 milliards de dollars en 2015 à plus de 2 500 milliards de dollars en 2026. Une part importante de ce capital a été investie dans des transactions liées aux logiciels et aux technologies, dont beaucoup étaient des rachats par endettement de sociétés SaaS à des valorisations qui supposaient une croissance des revenus à deux chiffres à perpétuité.

Ces hypothèses ont disparu quelque part entre la première démonstration de codage agentiel et le crash logiciel du premier trimestre 2026, mais les cibles ne semblaient pas s’en rendre compte.

Alors que de nombreuses sociétés SaaS cotées en bourse affichaient un multiple d’EBITDA de 5 à 8, les sociétés de logiciels soutenues par des fonds de capital-investissement présentaient des bilans valorisés à des multiples de revenus obsolètes, hérités d’acquisitions antérieures. Les dirigeants ont progressivement revu ces valorisations à la baisse : 1,00 $, 0,92 $, 0,85 $, tandis que les sociétés comparables cotées se négociaient à 0,50 $.

Moody’s abaisse la notation de 18 milliards de dollars de dettes logicielles garanties par des fonds de capital-investissement auprès de 14 émetteurs, invoquant des « retards de croissance des revenus liés aux perturbations concurrentielles induites par l’IA » ; il s’agit de la plus importante mesure prise sur un seul secteur depuis l’énergie en 2015 | Moody’s Investors Service, avril 2027

Tout le monde se souvient de ce qui s’est passé après la dégradation de la note. Les vétérans du secteur avaient déjà vu le scénario se répéter suite aux dégradations de la note énergétique de 2015.

Les prêts adossés à des logiciels ont commencé à faire défaut au troisième trimestre 2027. Les sociétés de portefeuille de capital-investissement spécialisées dans les services d’information et le conseil ont suivi. Plusieurs rachats par endettement (LBO) de plusieurs milliards de dollars de sociétés SaaS bien connues ont entamé une restructuration.

Zendesk était la preuve irréfutable.

Zendesk ne respecte pas ses engagements en matière de dette, l’automatisation du service client par l’IA érodant son chiffre d’affaires récurrent ; sa ligne de crédit directe de 5 milliards de dollars est valorisée à 0,58 $ ; il s’agit du plus important défaut de paiement jamais enregistré pour un logiciel de crédit privé | Financial Times, septembre 2027

En 2022, Hellman & Friedman et Permira ont racheté Zendesk pour 10,2 milliards de dollars. Le financement comprenait 5 milliards de dollars de prêts directs, le plus important jamais enregistré à l’époque adossé au chiffre d’affaires annuel récurrent (ARR), mené par Blackstone, avec la participation d’Apollo, Blue Owl et HPS. Ce prêt reposait explicitement sur l’hypothèse que le chiffre d’affaires annuel récurrent de Zendesk le resterait. Avec un ratio cours/bénéfice d’environ 25, un tel effet de levier n’était justifié que si cette hypothèse se confirmait.

À la mi-2027, ce n’était plus le cas.

Depuis près d’un an, des agents IA géraient le service client de manière autonome. La catégorie définie par Zendesk (gestion des tickets, routage, interactions avec le support humain) avait déjà été remplacée par des systèmes capables de résoudre les problèmes sans générer de ticket. Le revenu annuel récurrent sur lequel reposait le prêt n’était plus récurrent ; il s’agissait simplement d’un revenu non encore perçu.

Le plus important prêt garanti par ARR de l’histoire est devenu le plus important défaut de paiement de l’histoire des logiciels de crédit privés. Tous les services d’analyse de crédit se posaient simultanément la même question : qui d’autre est confronté à un vent contraire structurel déguisé en vent conjoncturel ?

Mais voici ce que le consensus a bien compris, du moins au départ : cette situation aurait dû être surmontable.

Le crédit privé n’est plus comparable au système bancaire de 2008. Son architecture a été conçue pour éviter toute vente forcée. Il s’agit de véhicules d’investissement à capital fixe, immobilisé par les investisseurs. Ces derniers s’engagent pour une durée de sept à dix ans. Il n’y a ni déposants à gérer, ni lignes de pension à mobiliser. Les gestionnaires peuvent conserver les actifs dépréciés, les redresser progressivement et attendre les recouvrements. Une situation délicate, mais gérable. Le système était conçu pour s’adapter, et non pour rompre.

Les dirigeants de Blackstone, KKR et Apollo ont évoqué une exposition au secteur des logiciels représentant entre 7 et 13 % de leurs actifs. Un niveau gérable. Tous les analystes financiers et les comptes rendus de crédit allaient dans le même sens : le crédit privé dispose de capitaux permanents. Il peut absorber des pertes qui, autrement, ruineraient une banque fortement endettée.

Capital permanent. Cette expression revenait sans cesse dans les conférences téléphoniques sur les résultats et les lettres aux investisseurs, censée rassurer. Elle est devenue un mantra. Et comme souvent avec les mantras, personne ne s’est attardé sur les détails. Voici ce qu’elle signifiait réellement…

Au cours de la décennie précédente, les grands gestionnaires d’actifs alternatifs avaient acquis des compagnies d’assurance-vie pour les transformer en véhicules de financement. Apollo avait racheté Athene, Brookfield American Equity et KKR Global Atlantic. Le raisonnement était imparable : les dépôts de rente offraient une base de passif stable et à long terme. Les gestionnaires investissaient ces dépôts dans les crédits privés qu’ils avaient créés et étaient rémunérés deux fois : une partie grâce aux excédents de trésorerie liés à l’assurance et une autre grâce aux commissions de gestion d’actifs. Un système de rémunération à la commission qui fonctionnait à merveille… sous certaines conditions.

Le crédit privé devait être financièrement viable.

Les pertes ont affecté des bilans conçus pour détenir des actifs illiquides en contrepartie d’obligations à long terme. Le « capital permanent » censé assurer la résilience du système n’était pas un fonds abstrait composé de capitaux institutionnels patients et d’investisseurs avertis prenant des risques sophistiqués. Il s’agissait de l’épargne des ménages américains, du citoyen lambda, structurée sous forme de rentes investies dans les mêmes titres de logiciels et de technologies soutenus par du capital-investissement qui étaient désormais en défaut de paiement. Le capital immobilisé, qui ne pouvait plus être dépensé, était l’argent des assurés en assurance-vie, et les règles sont quelque peu différentes dans ce domaine.

Comparativement au système bancaire, les autorités de régulation des assurances s’étaient montrées dociles, voire complaisantes, mais cet événement a sonné l’alarme. Déjà préoccupées par la concentration des crédits privés chez les assureurs-vie, elles ont commencé à abaisser le traitement des fonds propres basé sur les risques appliqué à ces actifs. Cela a contraint les assureurs à lever des capitaux ou à céder des actifs, deux options impossibles à des conditions avantageuses sur un marché déjà engorgé.

NEW YORK, LES AUTORITÉS DE RÉGLEMENTATION DE L’IOWA RENFORCENT LES CONDITIONS DE TRAITEMENT DU CAPITAL DE CERTAINS CRÉDITS NOTÉS PRIVÉ DÉTENUS PAR LES ASSUREURS VIE ; LES RECOMMANDATIONS DE LA NAIC DEVRAIENT AUGMENTER LES FACTEURS DE RBC ET DÉCLENCHER UN EXAMEN SUPPLÉMENTAIRE DES SVO | Reuters, novembre 2027

Lorsque Moody’s a placé la notation financière d’Athene sous perspective négative, l’action d’Apollo a chuté de 22 % en deux séances. Brookfield, KKR et d’autres ont suivi.

La situation n’a fait que se complexifier par la suite. Ces entreprises n’avaient pas seulement créé leur système d’assurance à effet perpétuel ; elles avaient bâti une architecture offshore élaborée, conçue pour maximiser les rendements grâce à l’arbitrage réglementaire. L’assureur américain souscrivait la rente, puis cédait le risque à un réassureur affilié, basé aux Bermudes ou aux îles Caïmans, qu’il possédait également. Ce réassureur avait été créé pour tirer parti d’une réglementation plus souple, autorisant la détention de moins de capital pour les mêmes actifs. Cette filiale levait des capitaux externes via des SPV offshore, un nouveau niveau de contreparties investissant aux côtés des assureurs dans des crédits privés émis par la branche de gestion d’actifs de la même société mère.

Les agences de notation, dont certaines appartenaient elles-mêmes à des fonds de capital-investissement, n’étaient pas des modèles de transparence (ce qui n’a surpris personne). L’écheveau complexe de différentes sociétés liées à des bilans distincts était d’une opacité stupéfiante. Lorsque les prêts sous-jacents ont fait défaut, il était impossible de déterminer en temps réel qui avait réellement supporté la perte.

Le krach de novembre 2027 a marqué un tournant, faisant basculer la perception d’une simple correction cyclique à une situation bien plus inquiétante. « Une série de paris corrélés sur la croissance de la productivité des cols blancs », a déclaré Kevin Warsh, président de la Réserve fédérale, lors de la réunion d’urgence du FOMC en novembre.

Voyez-vous, ce ne sont jamais les pertes elles-mêmes qui provoquent la crise, mais leur prise de conscience. Et il existe un autre domaine de la finance, bien plus vaste et bien plus important, pour lequel cette prise de conscience nous inquiète.

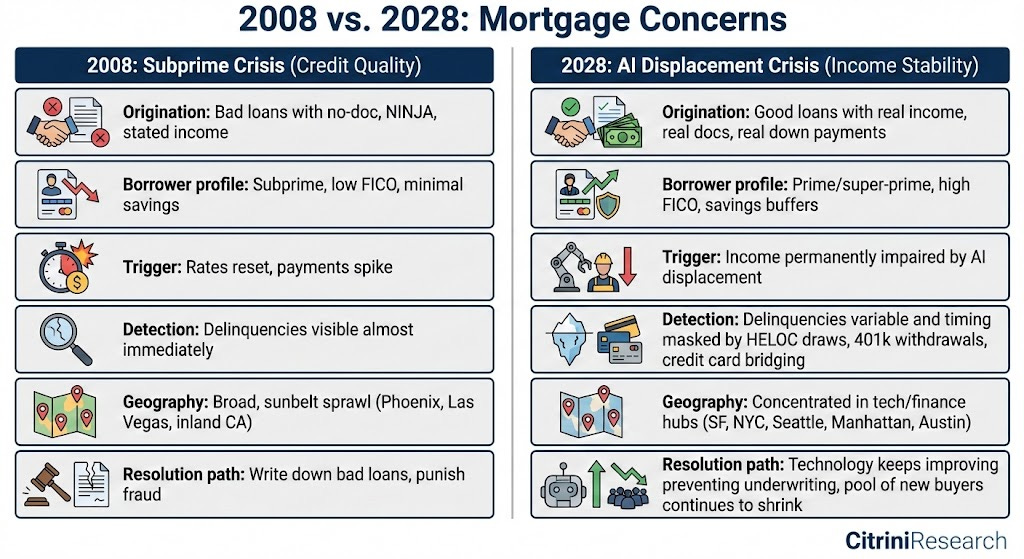

La question hypothécaire

L’indice Zillow des valeurs immobilières chute de 11 % en glissement annuel à San Francisco, de 9 % à Seattle et de 8 % à Austin ; Fannie Mae signale une hausse des retards de paiement précoces dans les codes postaux où plus de 40 % des emplois sont liés aux technologies et à la finance | Zillow / Fannie Mae, juin 2028

Ce mois-ci, l’indice Zillow des valeurs immobilières a chuté de 11 % à San Francisco, de 9 % à Seattle et de 8 % à Austin par rapport à l’année précédente. Ce n’est pas le seul sujet d’inquiétude. Le mois dernier, Fannie Mae a signalé une hausse des défauts de paiement précoces dans les zones à forte concentration d’emprunteurs à très haut risque – des zones peuplées d’emprunteurs ayant un score de crédit supérieur à 780 et généralement considérées comme très sûres.

Le marché des prêts hypothécaires résidentiels aux États-Unis représente environ 13 000 milliards de dollars. L’octroi d’un prêt hypothécaire repose sur l’hypothèse fondamentale que l’emprunteur conservera son emploi et son niveau de revenu actuel pendant toute la durée du prêt, soit trente ans dans la plupart des cas.

La crise de l’emploi des cols blancs a remis en cause cette hypothèse en entraînant une évolution durable des attentes en matière de revenus. Nous sommes désormais contraints de nous poser une question qui paraissait absurde il y a à peine trois ans : les prêts hypothécaires de premier ordre sont-ils un bon placement ?

Chaque crise hypothécaire survenue dans l’histoire des États-Unis a été provoquée par l’un des trois facteurs suivants : les excès spéculatifs (prêts accordés à des personnes qui n’avaient pas les moyens d’acheter des maisons, comme en 2008), les chocs de taux d’intérêt (la hausse des taux rendant les prêts hypothécaires à taux variable inabordables, comme au début des années 1980) ou les chocs économiques localisés (l’effondrement d’un seul secteur dans une seule région, comme le pétrole au Texas dans les années 1980 ou l’automobile dans le Michigan en 2009).

Aucun de ces éléments ne s’applique ici. Les emprunteurs en question ne sont pas des emprunteurs à risque. Leur score FICO est de 780. Ils ont versé un acompte de 20 %. Leurs antécédents de crédit sont irréprochables, leur situation professionnelle est stable et leurs revenus ont été vérifiés et justifiés dès l’octroi du prêt. Ce sont les emprunteurs que tous les modèles de risque du système financier considèrent comme la référence en matière de qualité de crédit.

En 2008, ces prêts étaient risqués dès le départ. En 2028, ils étaient rentables dès le départ. Le monde a tout simplement… changé après la souscription de ces prêts. Les gens ont emprunté sur un avenir auquel ils ne peuvent plus se permettre de croire.

En 2027, nous avons repéré les premiers signes de stress latent : une forte augmentation des tirages sur les marges de crédit hypothécaires, des retraits des plans d’épargne-retraite et de l’endettement par carte de crédit, alors que les paiements hypothécaires restaient à jour. Avec les pertes d’emploi, le gel des embauches et la réduction des primes, le ratio dette/revenu de ces ménages les plus aisés a doublé.

Ils pouvaient encore honorer leurs mensualités de prêt immobilier, mais seulement en cessant toute dépense non essentielle, en épuisant leurs économies et en reportant tout entretien ou amélioration de leur logement. Techniquement à jour dans leurs paiements, ils étaient cependant à la merci d’un seul imprévu qui les menaçait de faillite, et l’évolution des capacités de l’IA laissait présager cet imprévu. Nous avons alors constaté une forte augmentation des impayés à San Francisco, Seattle, Manhattan et Austin, alors même que la moyenne nationale restait dans les normes historiques.

Nous sommes actuellement dans la phase la plus critique. La baisse des prix de l’immobilier est gérable lorsque l’acheteur potentiel est en bonne santé financière. Or, dans le cas présent, cet acheteur potentiel subit la même perte de revenus.

Bien que les inquiétudes se multiplient, nous ne sommes pas encore confrontés à une crise des prêts hypothécaires généralisée. Les impayés ont augmenté, mais restent bien inférieurs aux niveaux de 2008. C’est la trajectoire de cette crise qui représente la véritable menace.

La spirale du déplacement des compétences en matière de renseignement compte désormais deux accélérateurs financiers qui contribuent au déclin de l’économie réelle.

Déplacements de main-d’œuvre, inquiétudes liées aux prêts hypothécaires, turbulences sur les marchés privés : chaque phénomène alimente l’autre. Les outils politiques traditionnels (baisse des taux, assouplissement quantitatif) peuvent certes agir sur le moteur financier, mais pas sur le moteur de l’économie réelle, car ce dernier n’est pas dicté par des conditions financières restrictives. Il est alimenté par l’intelligence artificielle, qui rend l’intelligence humaine moins rare et moins précieuse. On pourrait baisser les taux à zéro et racheter tous les titres adossés à des créances hypothécaires et toutes les dettes de rachat par endettement de logiciels en défaut de paiement sur le marché…

Cela ne changera rien au fait qu’un agent Claude peut faire le travail d’un chef de produit valant 180 000 $ pour 200 $/mois.

Si ces craintes se concrétisent, le marché hypothécaire s’effondrera au cours du second semestre. Dans ce cas, nous prévoyons que la baisse actuelle des actions atteindra un niveau comparable à celui de la crise financière mondiale (57 % entre le pic et le creux). Le S&P 500 se situerait alors aux alentours de 3 500 points, un niveau que nous n’avons plus atteint depuis le mois précédant l’incident ChatGPT en novembre 2022.

Ce qui est clair, c’est que les hypothèses de revenus sous-jacentes à 13 000 milliards de dollars de prêts hypothécaires résidentiels sont structurellement compromises. Ce qui ne l’est pas, c’est de savoir si les pouvoirs publics peuvent intervenir avant que le marché hypothécaire n’ait pleinement intégré les conséquences de cette situation. Nous sommes optimistes, mais nous ne pouvons nier les raisons de ne pas l’être.

La bataille contre le temps

Le premier cercle vicieux s’est manifesté dans l’économie réelle : l’amélioration des capacités de l’IA a entraîné une diminution des effectifs, un ralentissement des dépenses, un resserrement des marges, une augmentation des investissements des entreprises dans ce domaine et, par conséquent, une amélioration des capacités. Puis, le phénomène s’est étendu au secteur financier : la baisse des revenus a affecté les prêts hypothécaires, les pertes bancaires ont durci le crédit, l’effet de richesse s’est estompé et le cercle vicieux s’est accéléré. Ces deux phénomènes ont été exacerbés par une réponse politique insuffisante de la part d’un gouvernement qui semble, à vrai dire, désorienté.

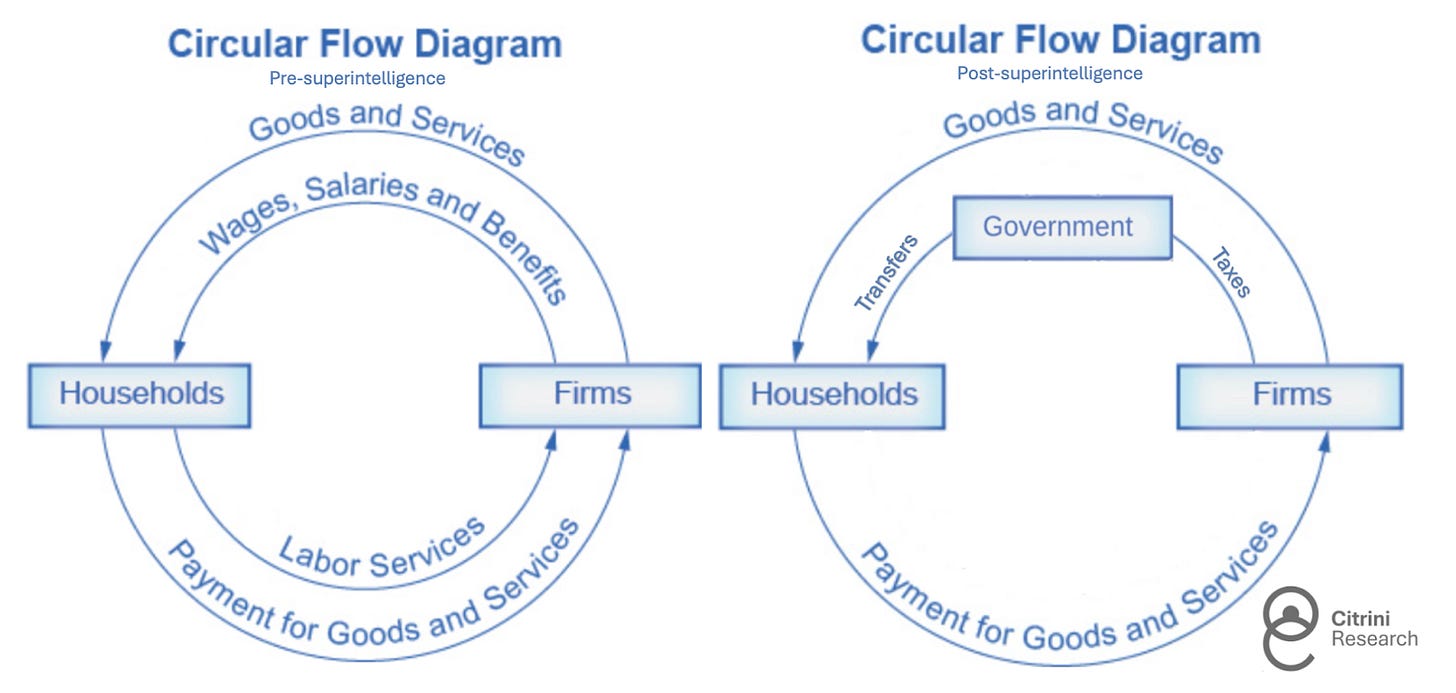

Le système n’a pas été conçu pour une crise de cette ampleur. Les recettes de l’État fédéral reposent essentiellement sur une taxe sur le temps de travail. Les citoyens travaillent, les entreprises les rémunèrent, et l’État prélève sa part. En temps normal, l’impôt sur le revenu et les cotisations sociales constituent la principale source de revenus.

Au cours du premier trimestre de cette année, les recettes fédérales étaient inférieures de 12 % aux prévisions de référence du CBO. Les recettes salariales diminuent car moins de personnes sont employées aux niveaux de rémunération antérieurs. Les recettes de l’impôt sur le revenu baissent car les revenus sont structurellement plus faibles. La productivité est en forte hausse, mais les gains profitent au capital et à l’informatique, et non au travail.

La part du travail dans le PIB est passée de 64 % en 1974 à 56 % en 2024, soit une baisse continue sur quatre décennies, alimentée par la mondialisation, l’automatisation et l’érosion constante du pouvoir de négociation des travailleurs. Au cours des quatre années qui ont suivi le début de l’essor exponentiel de l’IA, cette part est tombée à 46 %, soit la baisse la plus marquée jamais enregistrée.

La production est toujours présente. Mais elle ne transite plus par les ménages avant d’arriver aux entreprises, ce qui signifie qu’elle ne passe plus non plus par le fisc. Le circuit économique est rompu, et l’État devrait intervenir pour y remédier.

Comme à chaque récession, les dépenses augmentent tandis que les recettes diminuent. La différence, cette fois-ci, réside dans le fait que la pression sur les dépenses n’est pas conjoncturelle. Les stabilisateurs automatiques ont été conçus pour des pertes d’emplois temporaires, et non pour des mutations structurelles. Le système verse des allocations en partant du principe que les travailleurs seront réintégrés. Or, nombre d’entre eux ne le seront pas, du moins pas à un niveau de salaire comparable à celui d’avant la crise. Pendant la pandémie de COVID-19, le gouvernement a accepté sans scrupules des déficits de 15 %, mais il était entendu que cette situation serait temporaire. Les personnes qui ont besoin du soutien de l’État aujourd’hui n’ont pas été victimes d’une pandémie dont elles se remettront. Elles ont été remplacées par une technologie en constante évolution.

Le gouvernement doit transférer davantage d’argent aux ménages précisément au moment où il perçoit moins d’impôts.

Les États-Unis ne feront pas défaut. Ils impriment la monnaie qu’ils dépensent, la même qu’ils utilisent pour rembourser leurs emprunteurs. Mais ces tensions se manifestent ailleurs. Les obligations municipales présentent des signes inquiétants de dispersion de leurs performances depuis le début de l’année. Les États sans impôt sur le revenu s’en sont bien sortis, mais les obligations municipales générales émises par les États dépendants de l’impôt sur le revenu (majoritairement démocrates) ont commencé à intégrer un certain risque de défaut. Les responsables politiques l’ont vite compris, et le débat sur les bénéficiaires du sauvetage financier s’est polarisé selon les clivages partisans.

Il faut reconnaître à l’administration le mérite d’avoir rapidement pris conscience de la nature structurelle de la crise et d’avoir commencé à examiner des propositions bipartisanes pour ce qu’elle appelle la « loi sur l’économie de transition » : un cadre pour des transferts directs aux travailleurs déplacés, financé par une combinaison de dépenses déficitaires et d’une taxe proposée sur le calcul d’inférence de l’IA.

La proposition la plus radicale sur la table va encore plus loin. La « Loi sur la prospérité partagée de l’IA » instaurerait une redevance publique sur les retombées de l’infrastructure d’intelligence artificielle elle-même, un système hybride entre un fonds souverain et une redevance sur la production générée par l’IA, dont les dividendes financeraient des transferts sociaux aux ménages. Les lobbyistes du secteur privé ont inondé les médias de mises en garde contre les risques d’une telle dérive.

Les enjeux politiques de ces discussions étaient malheureusement prévisibles, exacerbés par les déclarations grandiloquentes et les manœuvres dangereuses. La droite qualifie les transferts et la redistribution de marxisme et prévient qu’une taxation excessive donnerait l’avantage à la Chine. La gauche, quant à elle, met en garde contre une taxe élaborée avec la complicité des élus en place, qui revient à une mainmise sur la réglementation. Les partisans d’une rigueur budgétaire extrême pointent du doigt des déficits insoutenables. Les partisans d’une austérité prématurée, eux, évoquent les leçons à tirer de l’austérité prématurée imposée après la crise financière mondiale. Ce fossé se creuse encore davantage à l’approche de l’élection présidentielle.

Pendant que les politiciens s’affrontent, le tissu social se délite plus vite que le processus législatif ne peut progresser.

Le mouvement Occupy Silicon Valley est emblématique d’un mécontentement plus général. Le mois dernier, des manifestants ont bloqué les entrées des bureaux d’Anthropic et d’OpenAI à San Francisco pendant trois semaines consécutives. Leur nombre ne cesse d’augmenter et les manifestations ont bénéficié d’une couverture médiatique plus importante que les chiffres du chômage qui les ont déclenchées.

Il est difficile d’imaginer que le public puisse détester davantage qui que ce soit que les banquiers après la crise financière mondiale, mais les laboratoires d’IA sont en passe de leur ravir la vedette. Et, du point de vue du grand public, à juste titre. Leurs fondateurs et premiers investisseurs ont accumulé des fortunes à un rythme qui ferait passer l’âge d’or américain pour une simple formalité. Les gains issus du boom de la productivité, qui profitent presque exclusivement aux propriétaires de la puissance de calcul et aux actionnaires des laboratoires qui l’utilisent, ont creusé les inégalités aux États-Unis à des niveaux sans précédent.

Chaque camp a son propre méchant, mais le véritable méchant, c’est le temps.

Les capacités de l’IA évoluent plus vite que les institutions ne peuvent s’adapter. Les politiques mises en œuvre suivent le rythme des idéologies, et non celui de la réalité. Si le gouvernement ne parvient pas rapidement à cerner le problème, les conséquences de ses actions se feront sentir.

Le décompression de la prime d’intelligence

Durant toute l’histoire économique moderne, l’intelligence humaine a été la ressource rare. Le capital était abondant (ou du moins, reproductible). Les ressources naturelles étaient finies mais substituables. Le progrès technologique était suffisamment lent pour permettre l’adaptation humaine. L’intelligence, c’est-à-dire la capacité d’analyser, de décider, de créer, de persuader et de coordonner, était la ressource non reproductible à grande échelle.

L’intelligence humaine tirait sa valeur intrinsèque de sa rareté. Chaque institution de notre économie, du marché du travail au marché hypothécaire en passant par le système fiscal, a été conçue pour un monde où cette hypothèse se vérifiait.

Nous assistons aujourd’hui à la disparition progressive de cette prime. L’intelligence artificielle est désormais une alternative compétente et en constante amélioration à l’intelligence humaine dans un nombre croissant de tâches. Le système financier, optimisé pendant des décennies pour un monde où les ressources humaines étaient rares, est en pleine réévaluation. Cette réévaluation est douloureuse, chaotique et loin d’être achevée.

Mais une réévaluation des prix n’est pas synonyme d’effondrement.

L’économie peut retrouver un nouvel équilibre. Y parvenir est l’une des rares tâches qui restent à la portée de l’humain. Nous devons le faire correctement.

C’est la première fois dans l’histoire que le principal facteur de productivité de l’économie crée moins d’emplois, et non plus. Aucun modèle existant n’est adapté, car aucun n’a été conçu pour un monde où la ressource rare devient abondante. Il nous faut donc élaborer de nouveaux modèles. La seule question qui compte est de savoir si nous y parviendrons à temps.

Mais vous ne lisez pas ceci en juin 2028. Vous le lisez en février 2026.

Le S&P 500 est proche de ses plus hauts historiques. Les mécanismes de rétroaction négative ne se sont pas encore enclenchés. Nous sommes convaincus que certains de ces scénarios ne se concrétiseront pas. Nous sommes tout aussi convaincus que l’intelligence artificielle continuera de progresser rapidement. La valeur ajoutée de l’intelligence humaine diminuera.

En tant qu’investisseurs, nous avons encore le temps d’évaluer dans quelle mesure nos portefeuilles reposent sur des hypothèses qui ne résisteront pas à l’épreuve de la décennie. En tant que société, nous avons encore le temps d’agir de manière proactive.

Le canari est toujours vivant.S’abonner

Remerciements : Merci à Sam Koppelman de Hunterbrook pour son aide à la relecture. Notre co-auteur, Alap Shah de LOTUS, a suggéré l’idée de cet article. CitriniResearch en a rédigé cet article, mais il en a écrit d’autres dans une série intitulée « Intelligence Explosion », que nous vous recommandons vivement de lire. Vous pouvez la trouver ici .

Citrini Research est une publication financée par ses lecteurs. Pour recevoir les nouveaux articles et soutenir mon travail, pensez à vous abonner gratuitement ou à un abonne