Anthropic, l’une des principales entreprises d’intelligence artificielle de la Silicon Valley, est engagée dans un bras de fer avec le Pentagone sur la question de savoir dans quelle mesure les puissants systèmes d’IA pourraient être utilisés à des fins de guerre et de surveillance.

Le différend porte sur le chatbot Claude d’Anthropic, qui fonctionnait sur des réseaux militaires américains classifiés et aurait été utilisé pour planifier l’opération visant à capturer le président vénézuélien Nicolas Maduro. Le département américain de la Guerre a donné à l’entreprise jusqu’à vendredi 17h01, heure de l’Est (22h01 GMT), pour accepter de lever les principales mesures de sécurité, sous peine d’être placée sur liste noire en tant que « risque pour la chaîne d’approvisionnement ».

Le PDG de Palantir, Alex Karp, analyse le bras de fer entre le Pentagone et Anthropic.

Karp a dit quelque chose que la plupart des PDG du secteur technologique ne diraient jamais à voix haute :

« Une petite île de la Silicon Valley qui rêve de décider de ce que vous mangez, de la façon dont vous mangez et de monétiser toutes vos données ne devrait pas non plus décider qui vit dans votre pays et dans quelles conditions. »

Il parle de son propre secteur d’activité.

Et son argument est simple.

Il y a des élections, il y a des règles.

Il y a un transfert de pouvoir d’un président à un autre.

La Silicon Valley ne peut pas passer outre cela.

« L’idée que la Silicon Valley a le pouvoir de décider ne devrait pas être la façon dont ces choses sont décidées. »

Cela lui a tout coûté.

Sa maison a été la cible de manifestations pendant un mois, les bureaux de Palantir ont également été le théâtre de manifestations.

Les employés ont exercé des pressions en interne et certains ont quitté l’entreprise.

Il n’a pas changé de cap.

L’intervieweur lui a ensuite demandé s’il soutenait l’approche de l’administration Trump.

Sa réponse pourrait vous surprendre.

« J’ai toujours été un progressiste convaincu. Ma famille est progressiste. J’ai un diplôme qui s’apparente à la pensée progressiste. »

Il a déclaré qu’il n’avait jamais cessé de critiquer cette administration.

Il n’a pas l’intention de voter pour.

Mais ensuite, il a dit ce qui a changé tout le débat anthropique.

« La question fondamentale est : qui décide ? »

Il ne s’agit pas de savoir si la politique est juste ni si vous êtes d’accord avec la mission.

Qui décide ?

Il a pris la chose personnellement.

« Il est de notoriété publique que notre logiciel est utilisé dans un contexte opérationnel de guerre. »

« Croyez-vous vraiment que le combattant va faire confiance à une société de logiciels qui coupe tout parce qu’un sujet devient controversé ? »

Laissez cela reposer un instant.

« Actuellement, pour un combattant, la vie dépend de son logiciel. »

« Ils ne vous feront jamais confiance si vous coupez les ponts simplement parce que vous êtes impopulaire. »

Il s’agit d’un homme dont le logiciel alimente des opérations militaires classifiées à travers l’Occident.

Il décrit ce qui se passe lorsque la confiance est rompue.

Appliquez maintenant cela à ce qui se passe en ce moment.

Anthropic a conçu Claude, la seule IA fonctionnant sur les réseaux classifiés du Pentagone.

Il a été utilisé lors de l’opération qui a permis la capture du président vénézuélien Nicolás Maduro en janvier.

Le Pentagone adore et ça marche.

Mais Anthropic a deux lignes rouges : pas de surveillance de masse des Américains et pas d’armes autonomes sans intervention humaine pour appuyer sur la gâchette.

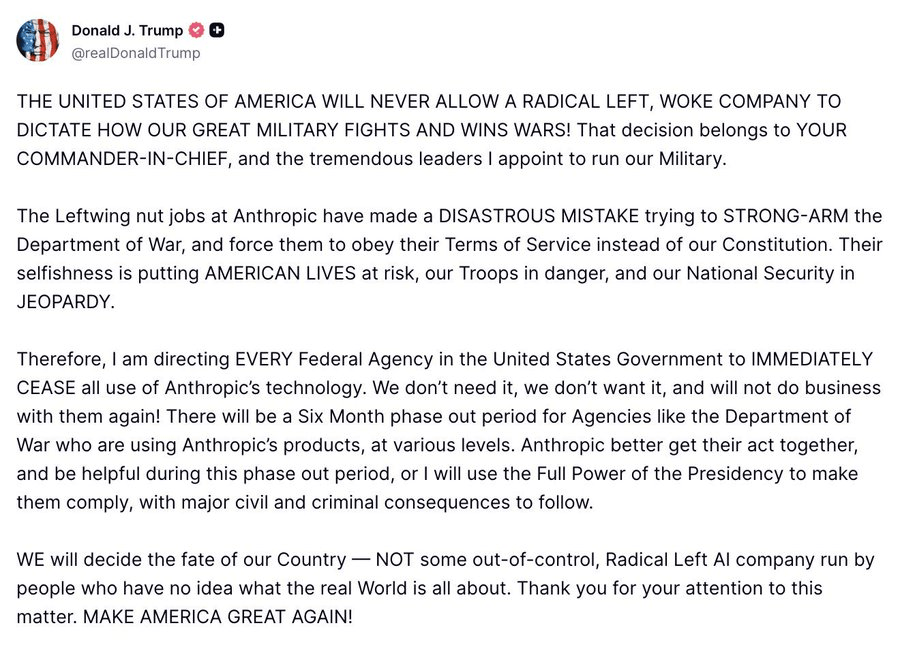

Le secrétaire à la Défense, Pete Hegseth, a donné à Anthropic une date limite : vendredi à 17 h 01.

Abandonnez les lignes rouges ou vous vous exposez à la loi sur la production de défense.

Le PDG d’Anthropic a refusé. « Nous ne pouvons en conscience accéder à leur demande. »

Mais c’est là que ça se complique.

Anthropic ne refuse pas de travailler avec l’armée, Claude le fait déjà.

Elle refuse deux choses précises. Deux.

Mais voilà le problème : le Congrès n’a adopté aucune loi régissant l’IA militaire.

Il n’y a pas d’élections à ce sujet et aucune règle.

Le Pentagone utilise le langage contractuel et les pouvoirs d’urgence hérités de la guerre froide pour décider de l’avenir de l’IA dans la guerre.

Ce n’est pas de la démocratie non plus.

Deux parties privées s’affrontent au sujet de règles que les élus auraient dû rédiger il y a des années.

La date limite est aujourd’hui. Vendredi. 17h01 heure de l’Est.

Si le gouvernement supprime ces garde-fous, aucun engagement en matière de sécurité de l’IA ne signifiera plus jamais rien.

Si Anthropic l’emporte, les PDG du secteur technologique deviendront les gardiens de la défense américaine.

Dans les deux cas, le système est défaillant.

Pourquoi Claude est important pour le Pentagone

Claude est profondément intégré aux processus de défense américains. L’entreprise affirme que ses modèles sont déjà utilisés par les agences de sécurité nationale pour l’analyse du renseignement, les simulations, la planification opérationnelle, les cyberopérations et d’autres tâches critiques. Anthropic est devenue la première entreprise d’IA à déployer des systèmes sur les réseaux classifiés du Pentagone, en signant un contrat pouvant atteindre 200 millions de dollars avec le département de la Guerre l’été dernier.

Les autres grands fournisseurs d’IA n’ont jusqu’à présent conclu que des accords pour exécuter leurs modèles sur les systèmes non classifiés de l’armée, ce qui place Claude dans une position privilégiée au sein de l’appareil de défense américain.

Quelles sont les exigences du Pentagone ?

La politique d’utilisation acceptable d’Anthropic pour le Département de la Guerre interdit formellement l’utilisation de Claude à des fins de surveillance intérieure de masse et pour des armes entièrement autonomes. Ces garanties contractuelles reflètent les règles internes de l’entreprise.

Le Pentagone a exigé la suppression de ces restrictions. Les responsables affirment vouloir pouvoir utiliser le système à « toutes fins légales » et, selon les médias américains, ont fait pression sur l’entreprise pour qu’elle fournisse une version « épurée » du modèle, débarrassée de toute contrainte morale et éthique.

« On ne peut pas mener des opérations tactiques par exception », a déclaré un responsable anonyme du Pentagone, cité par CNN, insistant sur le fait que « la légalité relève de la responsabilité du Pentagone en tant qu’utilisateur final ». L’armée soutient qu’elle ne peut se permettre d’être en situation de crise et de devoir demander à un entrepreneur privé l’autorisation de retirer des garde-corps.

Le secrétaire américain à la Guerre, Pete Hegseth, qui a rencontré cette semaine le PDG d’Anthropic, Dario Amodei, a publiquement déploré que le Pentagone n’ait pas besoin de réseaux neuronaux « incapables de combattre » et a menacé de désigner Anthropic comme un « risque pour la chaîne d’approvisionnement » – une étiquette généralement réservée aux entreprises considérées comme des extensions d’adversaires étrangers.

Le porte-parole du Pentagone, Sean Parnell, a affirmé que l’armée « n’a aucun intérêt à utiliser l’IA pour mener une surveillance de masse des Américains (ce qui est illégal) ni à utiliser l’IA pour développer des armes autonomes fonctionnant sans intervention humaine », mais a souligné : « Nous ne laisserons AUCUNE entreprise dicter les conditions de nos décisions opérationnelles. »

Quelles sont les lignes rouges d’Anthropic ?

Anthropic affirme être disposée à continuer de collaborer avec les agences de sécurité nationale américaines, mais ne renoncera pas à deux restrictions fondamentales concernant l’utilisation de ses systèmes.

« Les menaces ne changent rien à notre position : nous ne pouvons en conscience accéder à leur demande », a déclaré Amodei dans un communiqué jeudi, ajoutant que les exigences du Pentagone « n’ont jamais été incluses dans nos contrats… et nous estimons qu’elles ne devraient pas l’être maintenant ».

L’entreprise a clairement défini deux limites à son intelligence artificielle : elle déclare qu’elle ne soutiendra ni la surveillance de masse des citoyens américains, ni les armes entièrement autonomes.

Elle affirme que la surveillance à grande échelle des Américains est « incompatible avec les valeurs démocratiques » et que les modèles actuels ne sont « pas suffisamment fiables » pour prendre des décisions létales sans intervention humaine.

Amodei insiste sur le fait que ces dérogations n’ont pas empêché l’armée américaine d’utiliser Claude pour d’autres tâches « essentielles à la mission » et affirme que l’entreprise souhaite toujours soutenir la sécurité nationale américaine, mais pas au prix de la mise en place d’une surveillance de masse sur le territoire national ou de la possibilité de tuer de manière totalement autonome.

Anthropic peut-il survivre à une mise sur liste noire ?

Amodei affirme que le ministère de la Guerre a averti que, si Anthropic maintient ses mesures de sécurité, elle pourrait être retirée des systèmes militaires et déclarée « risque pour la chaîne d’approvisionnement » – une désignation jamais appliquée auparavant à une entreprise américaine.

Perdre un contrat d’une valeur maximale de 200 millions de dollars ne serait pas fatal pour Anthropic, dont la valeur avoisine les 400 milliards de dollars, mais une telle étiquette pourrait avoir des conséquences bien plus graves. Toute entreprise travaillant avec le Pentagone devrait prouver que ses propres systèmes ne dépendent pas de la technologie d’Anthropic, ce qui pourrait compliquer, voire compromettre, les grands contrats avec les entreprises qui fournissent également l’armée américaine.

Pour le département de la Guerre, rompre les liens serait également coûteux. Les responsables devraient remplacer les outils internes développés autour de Claude. Une source du Pentagone a déclaré aux médias américains que le système d’IA Grok d’Elon Musk était « prêt à être utilisé dans un cadre classifié », tout en reconnaissant que Grok n’était pas considéré comme aussi avancé que le modèle d’Anthropic.

La Silicon Valley va-t-elle réagir ?

La position du développeur a suscité une vague de soutien public inhabituelle au sein de la Silicon Valley. Jeudi soir, des centaines d’employés de Google et d’OpenAI – deux des principaux concurrents d’Anthropic, qui fournissent également des modèles d’IA à l’armée américaine – ont signé une lettre ouverte soutenant le refus de l’entreprise de se plier aux exigences du Pentagone.

La pétition, intitulée « Nous ne serons pas divisés », avait recueilli publiquement les signatures de 421 employés de Google et 76 d’OpenAI vendredi. Citant un article de presse américain, la lettre accuse le département de la Guerre de cibler Anthropic pour avoir « maintenu ses positions et refusé que ses modèles soient utilisés à des fins de surveillance de masse intérieure et pour tuer des personnes de manière autonome, sans contrôle humain ».

« Le Pentagone négocie avec Google et OpenAI pour tenter de les amener à accepter ce qu’Anthropic a refusé », écrivent les signataires, affirmant que des responsables cherchent à « diviser chaque entreprise en craignant que l’autre ne cède ». La lettre appelle les dirigeants des deux sociétés à « mettre de côté leurs différends et à s’unir pour continuer à refuser » les exigences du ministère de la Défense.

Que signifie cette confrontation pour l’IA ?

Le conflit entre Anthropic et le Pentagone a suscité l’intérêt des analystes des technologies et de la défense, qui craignent qu’il ne crée un précédent quant à la gouvernance de l’IA puissante dans les conflits futurs. Adam Connor, vice-président chargé des politiques technologiques au Center for American Progress, a déclaré aux médias américains que ce différend serait probablement perçu par l’ensemble du secteur comme un signe que les responsables de la défense ne souhaitent pas de limites contractuelles à l’utilisation des modèles avancés par les forces armées.

Si le Pentagone mettait ses menaces à exécution, les observateurs estiment qu’il s’agirait d’une escalade historique, transformant de facto l’un des produits d’IA commerciale les plus avancés des États-Unis en paria au sein même de son système de défense. Gregory Allen, conseiller principal au Centre d’études stratégiques et internationales, a affirmé qu’un tel traitement d’Anthropic reviendrait à sacrifier l’un des fleurons de l’industrie technologique américaine , à un moment où Washington compare la course à l’IA avec la Chine à la course à l’espace avec l’Union soviétique.